Odpowiedzialność sztucznej inteligencji czyli strach przed Skynetem

Jeśli przeczytałeś mój wpis to wiesz, że jest prosty sposób żeby sztuczna inteligencja odpowiadała za wyrządzone szkody tak jak Ty czy ja. A wszystko jak najbardziej w majestacie prawa. Tylko, czemu ten pomysł napotyka na taki opór wśród ustawodawców i większości prawników na świecie? Kto i dlaczego boi się odpowiedzialności sztucznej inteligencji ?

TERMINATOR I ODPOWIEDZIALNOŚĆ SZTUCZNEJ INTELIGENCJI

Ponieważ problem odpowiedzialności sztucznej inteligencji to dla wielu problem bajkowy, to od bajki zaczynam. No dobrze, nie do końca od bajki, ale od powieści, więc blisko. Otóż dawno, dawno temu ,przeczytałam bardzo mądre zdanie. Szło to mniej więcej tak:

„Strach to grzech pierworodny. Wszystko co złe na ziemi ma swój początek w strachu”

I moim zdaniem taka jest podstawowa przyczyna podchodzenia do problemu odpowiedzialności sztucznej inteligencji jak do jeża. O pomysłach w stylu nadania jej jakiejś osobowości prawnej albo chociaż ułomnej osobowości prawnej nie mówiąc.

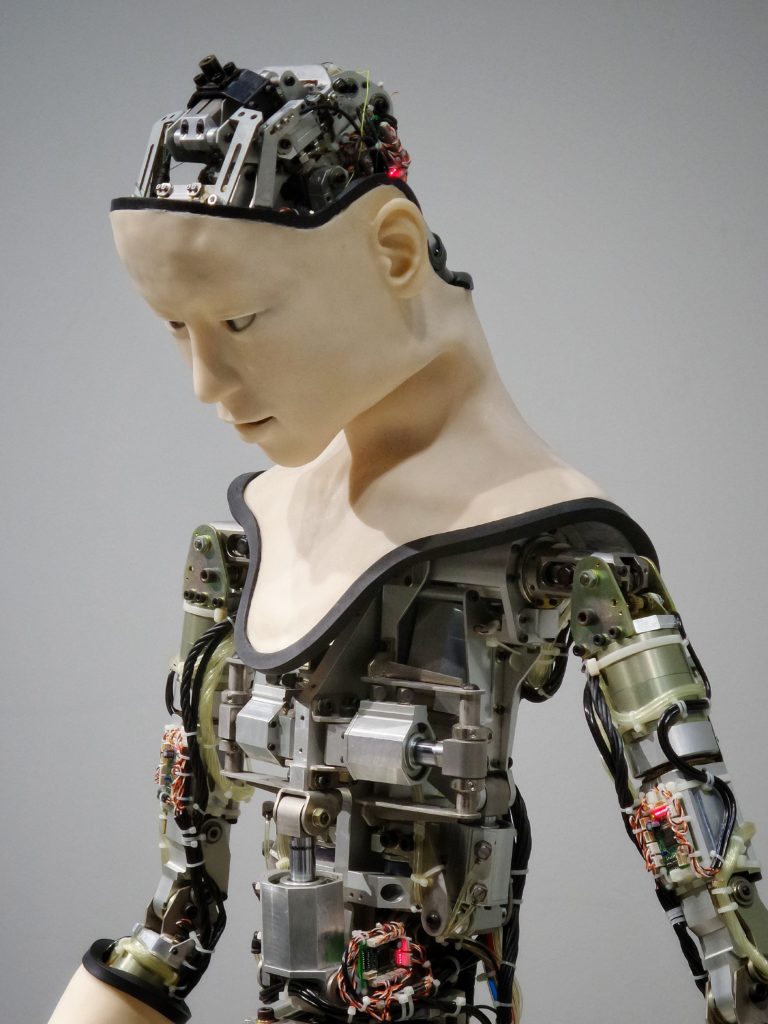

Boisz się tego czego nie znasz, a po drugie cała nasza popkultura wmówiła Ci, że wiesz dobrze czym pachnie uosabianie sztucznej inteligencji.

Władzę przejmie Skynet a metalowi terminatorzy będą przemierzać opustoszałe ulice w poszukiwaniu niedobitków ludzkości. Ewentualnie będziemy żyć w matrixie jako bateryjki dla żądnych energii maszyn.

I tak dalej, i tak dalej. Strach się sprzedaje, o czym dobrze wiedzą i filmowcy i pisarze, i niestety dziennikarze też. A prawnicy, premierzy, prezydenci, parlamentarzyści na całym świecie jeśli już nie czytają tych samych książek, to z pewnością oglądają te same filmy. Przecież jesteśmy globalną wioską, pamiętasz?

Bądźmy szczerzy: popkultura utrwaliła nam wszystkim w głowach pewien obraz sztucznej inteligencji. I niestety jest to obraz negatywny, żeby nie powiedzieć przerażający.

Z dużą dozą prawdopodobieństwa takiego „Terminatora” i „Matrixa” obejrzała większość parlamentarzystów, członków rządów, prezydentów, prawników i wszelkiej maści ekspertów od IT i robotyki w tak zwanym „cywilizowanym świecie. A nawet jeśli nie obejrzała, to na pewno o nich słyszała. O innych filmach i książkach ze sztuczną inteligencją w roli czarnego charakteru nie wspominając.

Jeśli sądzisz, że to, nomen omen, sztuczne wyobrażenie sztucznej inteligencji nie działa na twórców przepisów, to się grubo mylisz. Wszyscy jesteśmy ludźmi. Skoro działa na Ciebie i mnie, to na nich też.

INTELIGENCJA INTELIGENCJI NIE RÓWNA. SZTUCZNA TEŻ.

Oczywiście we wszystkich tych dziełach sztuczna inteligencja jest nie tylko piekielnie inteligentna i złowieszcza, ale przede wszystkim jest w pełni autonomiczna i ma własną świadomość. Jest niewinny telefon komórkowy, a potem od razu Skynet. Nie ma niczego pomiędzy. Tymczasem to „pomiędzy” jest bardzo istotne, bo mówiąc o prawnej odpowiedzialność sztucznej inteligencji póki co mamy właśnie do czynienia z tym „pomiędzy”. Czyli mamy czas na to, żeby się dobrze przygotować. Także pod kątem przepisów na ewentualną w pełni autonomiczną, samouczącą się i samoświadomą sztuczną inteligencję.

RANKING INTELIGENCJI SZTUCZNEJ INTELIGENCJI CZYLI AUTA

Czyli z czym my się tak naprawdę mierzymy jeśli chodzi o odpowiedzialność sztucznej inteligencji i ewentualne nadanie jej osobowości prawnej? Innymi słowy jakie mamy obecnie stopnie zaawansowania SI? Najlepiej pokazać to na przykładzie. Świetnym są automatyczne samochody i inne pojazdy.

Jedyna, naprawdę konkretna próba sklasyfikowania sztucznej inteligencji została podjęta przez międzynarodową organizację zrzeszająca inżynierów zajmujących się motoryzacją, lotnictwem wykorzystaniem maszyn w przemyśle. Mam na myśli SAE International czyli The Society of Automotive Engineers. Standardy klasyfikacji stopnia automatyzacji pojazdów wprowadzone przez SAE są na tyle dobre, że obecnie posługują się nimi praktycznie wszyscy, w tym również Unia Europejska. Jeśli interesuje Cię szczegóły tego rankingu, to zapraszam na stronę SAE International (link powyżej) czy ERTRAC czyli the European Road Transport Research Advisory Council (Europejski Komitet Doradczy ds. Badań Transportu Drogowego).

Poniżej podaję podstawy tej 6 stopniowej klasyfikacji. Im wyższy poziom automatyzacji pojazdu, tym wyższy udział sztucznej inteligencji w jego prowadzeniu.

POZIOM 0 : Czyli zero automatyzacji w prowadzonym pojeździe. Za prowadzenie auta czy innego pojazdu w 100% jest odpowiedzialny kierowca.

POZIOM 1: Co prawda pojazd prowadzi człowiek, ale jeśli chce, może liczyć na jakąś pomoc ze strony pojazdu. Na przykład możesz sobie ustawić tempomat albo asystenta parkowania równoległego.

POZIOM 2: Ten poziom, to już częściowa automatyzacja. Za kierowanie, zwalnianie czy przyspieszanie pojazdu odpowiada system, ale to człowiek monitoruje działania systemu. Nawet jeśli kierowca nie trzyma rąk na kierownicy i auto prowadzi program, kierowca wciąż musi patrzeć na drogę i monitorować sytuację tak, żeby w każdej chwili móc przejąć kontrolę nad pojazdem.

POZIOM 3: Warunkowa automatyzacja prowadzenia. Od częściowej automatyzacji różni się tym, że kierowca nie musi cały czas monitorować otoczenia i drogi. Może zawierzyć systemowi, który prowadzi samochód. Z tym, że człowiek wciąż musi być gotowy do przejęcia kontroli nad pojazdem. System ma możliwość zaalarmowania kierowcy, kiedy uzna, że prowadzenie musi przejąć człowiek. Auta z warunkową automatyzacją prowadzenia mają na przykład opcję jazdy w korku albo po autostradzie na tzw. autopilocie.

POZIOM 4: Wysoki poziom automatyzacji. Od stopnia 3 różni się tym, że system jest bardziej zaawansowany, lepiej dostosowuje się do warunków drogowych i z założenia ma znacznie rzadziej prosić o pomoc człowieka. System ma się deaktywować tylko wtedy gdy kierowca życzy sobie poprowadzić albo kiedy stwierdzi, że warunki drogowe są tak odmienne od tego do czego jest zaprogramowany, że nie da rady. W praktyce to drugie ma się zdarzać bardzo, bardzo rzadko. Kierowca może się zajmować swoimi sprawami całą drogą. Nie mniej jednak, wciąż, przynajmniej teoretycznie, system może go poprosić o przejęcie kierowania pojazdem.

POZIOM 5: Pełna automatyzacja. Czyli system nie potrzebuje ludzkiego kierowcy. Sztuczna inteligencja cały czas sama prowadzi samochód.

CO Z TEGO WYNIKA DLA ODPOWIEDZIALNOŚCI SZTUCZNEJ INTELIGENCJI ?

Co z tego rankingu stopni automatyzacji wynika? Ano moim zdaniem po pierwsze to, że tę klasyfikację można tak naprawdę potraktować jako ranking udziału sztucznej inteligencji w prowadzeniu pojazdu. Po drugie, taką „miarkę” stopnia udziału sztucznej inteligencji w prowadzeniu pojazdu można sobie łatwo zastosować do każdej innej czynności czy procesu. Czemu nie na przykład do „inteligentnej” pralki czy oprogramowania do diagnozowania chorób online albo systemu przyznającemu rolnikom jakieś państwowe dotacje?

Po trzecie ze sztuczną inteligencją w rodzaju Skynetu z „Terminatora” będę miała do czynienia dopiero na poziomie 5.

Co to oznacza dla odpowiedzialności sztucznej inteligencji? Ano, że pełną i wyłączną odpowiedzialność SI za ewentualne szkody mam dopiero na poziomie 5. Wcześniej mam współodpowiedzialność człowieka. W postępowaniu dowodowym dałby się zapewne ustalić, kto zawinił bardziej: człowiek czy SI gdyby dajmy na to auto zderzyło się z innym samochodem albo inteligentna pralka eksplodowała me w łazience przez co zalałam sąsiadów.

Odpowiedzialność cywilną sztucznej inteligencji można by też ubezpieczać. Czy to chodzi o system prowadzący samochód czy inteligentną pralkę. Kto miałby wykupić polisę? A to już jest kwestia do doregulowania. Mógłby być do tego zobowiązany producent auta czy pralki. Możliwości jest naprawdę wiele.

Oczywiście, wszystkie te pomysły na nic dopóki sztuczna inteligencja nie zostanie uosobowiona prawnie albo nie zastosujemy jakiegoś innego rozwiązania prawnego Jak pisałam w poprzednim wpisie o odpowiedzialności sztucznej inteligencji za wyrządzone szkody: na razie żadne prawo na świecie, z polskim włącznie nie umożliwia sztucznej inteligencji ponoszenia odpowiedzialności cywilnej. W tej chwili odpowiedzialność może ponieść tylko człowiek, osoba prawna albo jakaś „ułomna” osoba prawna (czyli taka nie do końca- w polskim prawie takimi „ułomnymi” osobami prawnymi są przykład spółka jawna albo spółka partnerska). Poza tym, kto nam broni wymyślić i zastosować jeszcze jakieś zupełnie nowe rozwiązanie skrojone właśnie dokładnie pod sztuczną inteligencję?

To ludzie stanowią prawo. My je wymyślamy, nie na odwrót.

Oczywiście do tego trzeba by było sporo odwagi i wizjonerstwa. A strach przed uosabianiem sztucznej inteligencji, paraliżuje przed myśleniem.

Jakby tego było mało, jest jeszcze spora grupa ekspertów, która co prawda odpowiedzialności sztucznej inteligencji się nie boi, ale za to ma dziesiątki powodów, którymi jest gotowa uzasadnić czemu o jakiejś formie osobowości prawnej dla SI możemy zapomnieć. I dlaczego w związku z tym cywilna i każda inna odpowiedzialność sztucznej inteligencji to fikcja. O tym będzie w kolejnych wpisach.

Pozdrawiam, Prawstoria.